Radiografías deepfake preocupan a los médicos: ni los humanos ni la IA las distinguen

No es ciencia ficción: es vulnerabilidad documentada. Se viene la generación deepfake de imágenes 3D, como tomografías y resonancias.

27.03.2026 09:07

Una investigación publicada en la revista Radiology reveló un nuevo problema que se está generando para la salud mundial a causa del mal uso de las tecnologías. Lo que ocurre es que hay imagenología médica generada por inteligencia artificial (IA) que engaña incluso a los especialistas más experimentados. Las implicancias para la seguridad clínica y jurídica son serias.

Según reveló un estudio publicado el 24 de marzo en la revista de la Sociedad Radiológica de América del Norte, está pasando que tanto los radiólogos como los modelos de inteligencia artificial más avanzados tienen dificultades reales para diferenciar entre radiografías reales e imágenes creadas por IA.

Cómo se hizo el estudio

La investigación, liderada por el doctor Mickael Tordjman, del centro Mount Sinai (Nueva York), involucró a 17 radiólogos de 12 instituciones en seis países: Estados Unidos, Francia, Alemania, Turquía, Reino Unido y Emiratos Árabes Unidos. Su experiencia abarcaba desde médicos en formación hasta especialistas con cuatro décadas de trayectoria.

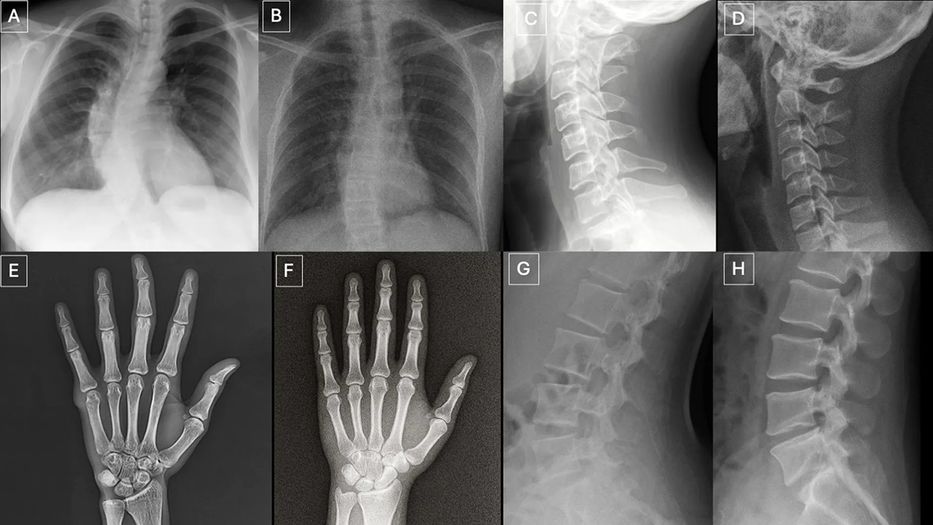

En total se analizaron 264 imágenes: la mitad eran reales y la otra mitad, generadas por IA. Se usaron dos tecnologías distintas para crear las imágenes falsas: ChatGPT (de OpenAI) y RoentGen, un modelo de difusión generativa de código abierto desarrollado por investigadores de Stanford Medicine.

Los resultados mostraron que, cuando los profesionales no sabían que podía haber imágenes falsas entre las que tenían para evaluar, solo el 41% logró identificarlas. Al ser informados de que existían imágenes sintéticas, su precisión promedio subió al 75%.

Los modelos de IA tampoco aprobaron la prueba con buena nota. Cuatro sistemas —GPT-4o y GPT-5 (OpenAI), Gemini 2.5 Pro (Google) y Llama 4 Maverick (Meta)— alcanzaron tasas de acierto de entre el 57% y el 85%. De hecho, GPT-4o, el mismo modelo que generó las imágenes falsas, no fue capaz de detectarlas todas, aunque superó a los demás.

Otro dato que vale la pena marcar: los años de experiencia de un radiólogo no hicieron la diferencia en la capacidad para detectar las imágenes falsas. Sí lo hizo la subespecialidad: los radiólogos musculoesqueléticos se desempeñaron significativamente mejor que sus colegas.

“Demasiado perfectas para ser reales”

El doctor Tordjman describió con precisión qué hace que una radiografía deepfake sea sospechosa: “Las imágenes médicas deepfake a menudo lucen demasiado perfectas. Los huesos son excesivamente lisos, las columnas vertebrales antinaturalmente rectas, los pulmones demasiado simétricos, los patrones de vasos sanguíneos uniformes en exceso, y las fracturas aparecen inusualmente limpias y consistentes, a menudo limitadas a un solo lado del hueso”.

Esa perfección artificial, paradójicamente, es la principal pista.

Lo que preocupa a los profesionales es que esta tecnología caiga en las manos equivocadas y se pueda utilizar para fraguar estudios o pruebas médicas vinculadas a procesos judiciales. Tordjman dijo que “esto crea una vulnerabilidad de alto riesgo para litigios fraudulentos si, por ejemplo, una fractura fabricada pudiera ser indistinguible de una real”.

El investigador también advirtió sobre las amenazas de ciberseguridad que se pueden dar: “Si hackers accedieran a la red de un hospital e inyectaran imágenes sintéticas para manipular diagnósticos de pacientes o provocar un caos clínico generalizado, se estaría socavando la confiabilidad fundamental del registro médico digital”.

No es un escenario de ciencia ficción: es una vulnerabilidad documentada.

Y lo que se viene, según los especialistas, es la generación deepfake de imágenes 3D, como tomografías computarizadas y resonancias magnéticas. Para mitigar los riesgos, el estudio recomienda implementar marcas de agua invisibles integradas en las imágenes y firmas criptográficas vinculadas al técnico que capturó cada estudio.

Para fomentar la educación y la concienciación, los investigadores han publicado un conjunto de datos deepfake seleccionado que incluye cuestionarios interactivos con fines de formación, informa el sitio Science Daily.

Acerca de los comentarios

Hemos reformulado nuestra manera de mostrar comentarios, agregando tecnología de forma de que cada lector pueda decidir qué comentarios se le mostrarán en base a la valoración que tengan estos por parte de la comunidad. AMPLIAREsto es para poder mejorar el intercambio entre los usuarios y que sea un lugar que respete las normas de convivencia.

A su vez, habilitamos la casilla [email protected], para que los lectores puedan reportar comentarios que consideren fuera de lugar y que rompan las normas de convivencia.

Si querés leerlo hacé clic aquí[+]