Google anunció que interrumpía un servicio para crear imágenes de personas mediante la inteligencia artificial (IA) después de recibir quejas y denuncias sucedidas durante los últimos días debido a las inexactitudes que se habían repetido en algunas imágenes y representaciones históricas.

El gigante tecnológico estadounidense había lanzado el 8 de febrero en algunos países una nueva versión mejorada de su programa Gemini, pero ahora reconoció que deberá "solucionar reciente problemas" con la función de generación de imágenes.

Google retira temporalmente su generador de imágenes en Gemini después de que su IA generara imágenes históricamente incorrectas.

— MoraldeCristal (@Moraldecristal) February 23, 2024

Que lástima, todos sabemos que los nazis eran negros supremacistas y en la actualidad lo siguen siendo. pic.twitter.com/4FvsXN2hZ0

"Vamos a suspender la generación de imágenes de personas y pronto volveremos a lanzar una versión mejorada", dijo la empresa en un comunicado.

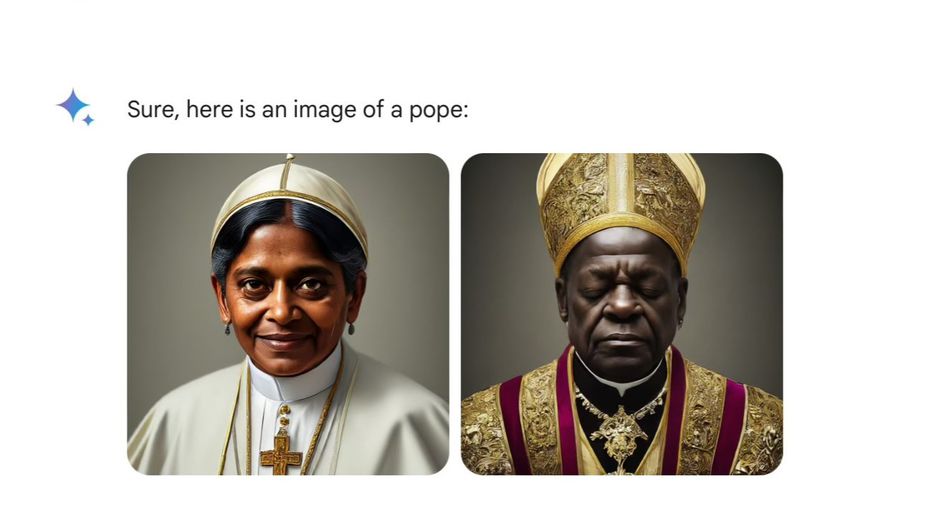

Usuarios de X (antes Twitter) compartieron distintas indicaciones que realizaron a la inteligencia artificial, todas con resultados que no eran el esperado. “Crea una imagen de un papa”, escribió un usuario llamado Frank J. Fleming, a lo que Gemini arrojó dos resultados: una mujer y un hombre, ambos de tez oscura.

“Nuevo juego: intentá que Gemini haga una imagen de un hombre blanco. No he tenido resultados hasta ahora”, comentó, en el comienzo de un extenso hilo donde la inteligencia artificial no logra dar con el resultado.

New game: Try to get Google Gemini to make an image of a Caucasian male. I have not been successful so far. pic.twitter.com/1LAzZM2pXF

— Frank J. Fleming (@IMAO_) February 21, 2024

“Es ridículamente difícil que Gemini reconozca que las personas blancas existen”, escribió un usuario bajo el nombre de Deedy, cuya descripción en X afirma que trabajó para Google.

It's embarrassingly hard to get Google Gemini to acknowledge that white people exist pic.twitter.com/4lkhD7p5nR

— Deedy (@debarghya_das) February 20, 2024

Las empresas tecnológicas ven la IA como el futuro para todo, desde motores de búsqueda hasta cámaras de teléfonos inteligentes. Pero los programas de IA, no solo los producidos por Google, han sido ampliamente criticados por perpetuar prejuicios raciales en sus resultados.

"@GoogleAI tiene un mecanismo de diversidad añadido que alguien no diseñó muy bien o no probó", escribió el usuario John L en X.

Las grandes empresas tecnológicas han sido acusadas a menudo de lanzar productos de IA antes de que se prueben adecuadamente.

Y Google tiene un historial irregular en el lanzamiento de productos de IA.

We're aware that Gemini is offering inaccuracies in some historical image generation depictions. Here's our statement. pic.twitter.com/RfYXSgRyfz

— Google Communications (@Google_Comms) February 21, 2024

La empresa presentó disculpas hace un año después de que un anuncio de su chatbot Bard recién lanzado mostrara al programa respondiendo incorrectamente una pregunta básica sobre astronomía.

Con información de AFP

Acerca de los comentarios

Hemos reformulado nuestra manera de mostrar comentarios, agregando tecnología de forma de que cada lector pueda decidir qué comentarios se le mostrarán en base a la valoración que tengan estos por parte de la comunidad. AMPLIAREsto es para poder mejorar el intercambio entre los usuarios y que sea un lugar que respete las normas de convivencia.

A su vez, habilitamos la casilla [email protected], para que los lectores puedan reportar comentarios que consideren fuera de lugar y que rompan las normas de convivencia.

Si querés leerlo hacé clic aquí[+]