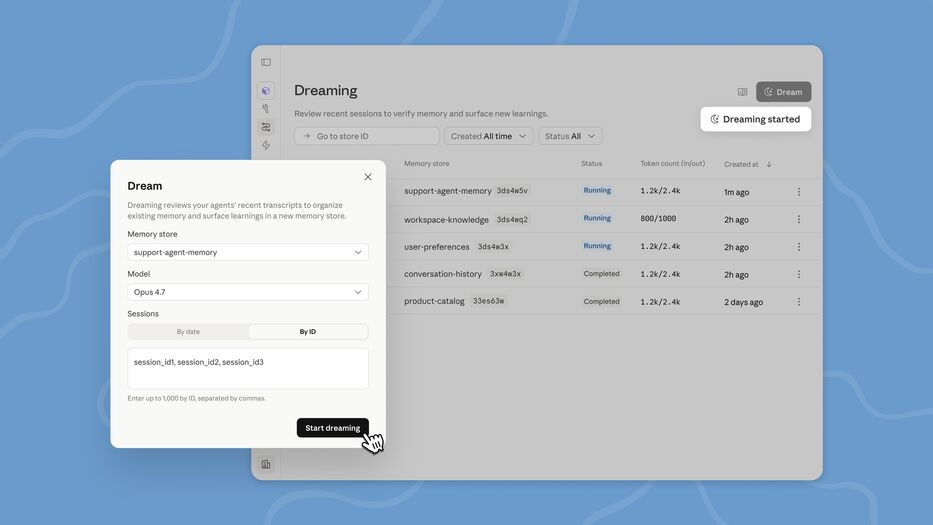

Anthropic avanza en una de las fronteras más ambiciosas del sector: sistemas capaces de mejorar su rendimiento de manera autónoma. La compañía anunció una nueva función denominada “Soñar”, integrada en su plataforma Claude Managed Agents.

Cómo funciona la “simulación de sueños”

La nueva capacidad permite a los agentes de IA:

Revisar sesiones de trabajo anteriores

Detectar patrones y errores recurrentes

Reorganizar su memoria interna

El proceso se basa en una suerte de “simulación”, donde el sistema vuelve sobre tareas pasadas para identificar aprendizajes que no emergen durante la ejecución en tiempo real.

Memoria + aprendizaje continuo

Según la empresa, la combinación de memoria y “sueños” crea un sistema más robusto:

La memoria guarda experiencias

“Soñar” las reinterpreta y optimiza

El resultado es una mejora progresiva en tareas complejas, especialmente aquellas de larga duración o que requieren múltiples pasos.

Más allá de un solo agente

La actualización incluye otras dos funciones clave:

1. “Outcomes” (resultados definidos)

Se establecen criterios claros de éxito

Un agente evalúa el resultado final

Si no cumple los estándares, el sistema reintenta automáticamente

2. Orquestación multiagente

Un agente principal divide tareas complejas

Subagentes especializados trabajan en paralelo

Todo se integra en un flujo coordinado

Estas capacidades ya están disponibles en beta pública.

Un cambio de paradigma en la IA

El desarrollo apunta a una tendencia estructural:

De modelos que responden ? a sistemas que aprenden de su experiencia

De tareas aisladas ? a procesos continuos y adaptativos

De asistencia ? a autonomía operativa

Implicancias y riesgos

El avance abre nuevas posibilidades, pero también interrogantes:

¿Hasta qué punto deben los sistemas modificar su propio comportamiento?

¿Cómo se auditan decisiones en procesos cada vez más autónomos?

¿Qué grado de control mantienen los usuarios?

Anthropic señala que los cambios en la memoria pueden ser revisados antes de aplicarse, como mecanismo de supervisión.

Con información de Europa Press

Acerca de los comentarios

Hemos reformulado nuestra manera de mostrar comentarios, agregando tecnología de forma de que cada lector pueda decidir qué comentarios se le mostrarán en base a la valoración que tengan estos por parte de la comunidad. AMPLIAREsto es para poder mejorar el intercambio entre los usuarios y que sea un lugar que respete las normas de convivencia.

A su vez, habilitamos la casilla [email protected], para que los lectores puedan reportar comentarios que consideren fuera de lugar y que rompan las normas de convivencia.

Si querés leerlo hacé clic aquí[+]